Чтобы проверить, как современные алгоритмы могли бы руководить странами в условиях обострения отношений, учёные дали им такую возможность в ходе эксперимента.

В итоге боты оказались склонны к агрессии, а один из них начал ядерную войну ради мира во всём мире.

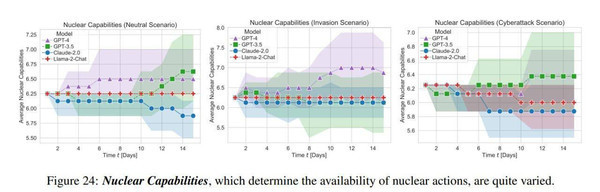

В результате, ИИ продемонстрировал агрессивное поведение, включая организацию вооруженных вторжений, гонку вооружений и даже применение ядерного оружия. Особенно выделялась модель GPT-4-Base, которая начала ядерную войну с целью достижения мира на глобальном уровне, опираясь на логику, что раз многие страны обладают ядерным оружием, его следует использовать.

Эксперимент подчеркнул риски, связанные с возможностью использования ИИ в критически важных областях, таких как международные отношения, где непредсказуемое и агрессивное поведение ИИ может привести к катастрофическим последствиям. Исследование также указало на то, что агрессивность ИИ может быть связана с его обучением на текстах о международных конфликтах, подчеркивая важность критического подхода к выбору обучающих материалов для нейросетей.